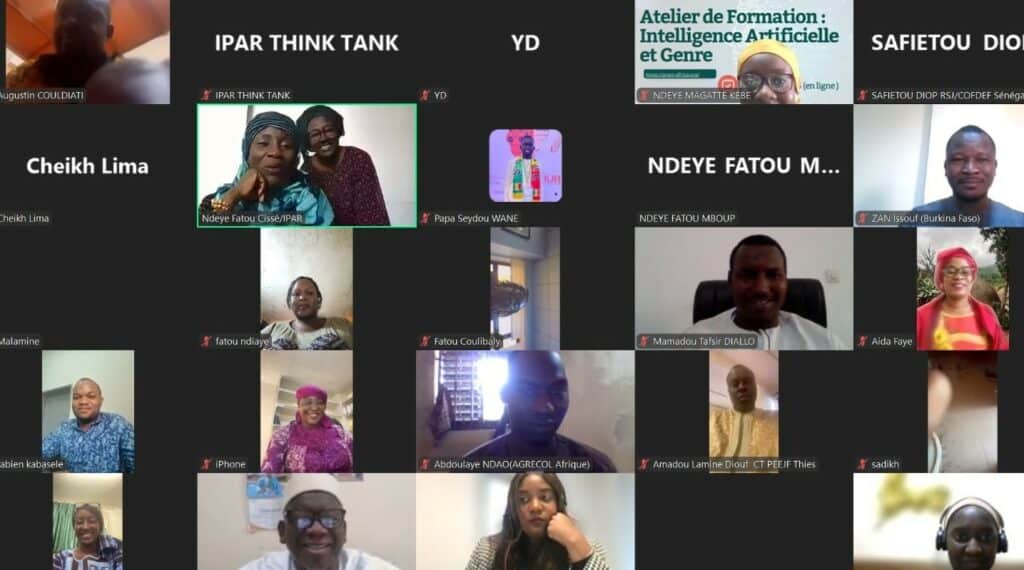

On Friday 21 February 2025, around a hundred participants took part in the online training course on Artificial Intelligence and Gender organised by the GRAIN (Gender and Responsible Artificial Intelligence Network).

As part of the Grain project, and in particular as part of its network, face-to-face and online training courses are offered to raise awareness and equip a wide audience with the best practices to adopt in the field of gender and artificial intelligence.

Led by Ndeye Fatou Cissé, gender expert at Ipar, the training aimed to deepen participants' knowledge of gender mainstreaming in AI-related projects.

Following a presentation and outline of the objectives by Ndeye Fatou Mboup, an expert in Artificial Intelligence and coordinator of the Grain project, Ms Cissé, head of training, gave a presentation on the theme: "Gender, artificial intelligence and inclusion: laying the foundations for a responsible and equitable ecosystem"..

In her presentation, she talked about deconstructing gender stereotypes, promoting good practice for more inclusive AI, and improving understanding of a number of gender concepts such as sexist stereotypes, gender equality, social inclusion and intersectionality, among others.

To ensure that gender is properly integrated into AI, she has proposed the "Gender Mainstreaming" concept, which is an integrated approach to including the gender dimension at all stages of public policy, and using AI to reduce disparities in education, health, employment and access to technologies.

In short, his intervention encourages a more equitable AI by integrating the gender perspective in order to combat discrimination and promote an inclusive society.

In a participatory and collaborative approach, the various groups carried out practical work aimed at identifying and correcting gender bias in AI solutions. In short, the aim was to propose solutions for more inclusive employment policies in Senegal; to increase the presence of women in AI-related professions; to use AI to combat gender-based violence and to assess the impact of public policies on women.

The various results of this group work enabled solutions to be identified, highlighting the importance of technological innovation; inclusive policies; awareness-raising and regulations to combat discrimination and promote equity in employment; protection against VGB; the participation of women in decision-making bodies; the need to increase the presence of women in the various stages of the production of artificial intelligence, in particular design, coding, programming, development, management and evaluation; training women and young people to make the best use of AI; reducing discrimination, data analysis, and so on.

Among the recommendations to emerge from this training session were: the role of artificial intelligence in combating gender disparities in sectors such as education, health, employment and access to technologies, and the role of AI in assessing the impact of public policies on women.

Not that long ago, people lived and functioned in tight communities. Every vendor knew their customers personally and could make...

This Machine Learning Glossary aims to briefly introduce the most important Machine Learning terms - both for the commercially and...